研究:像 ChatGPT 这样的 AI 工具让学习更轻松,也更具说服力

新研究发现,相比人类撰写的历史摘要,AI 生成的内容不仅能帮助人们记住更多事实,还更容易影响他们的政治观点。

在不确定中依赖人工智能:领导者是否正在“外包”自己的判断?

部分企业管理者在面对不确定性和压力时,正将决策与思考过度交给大型语言模型,这一做法引发对领导力与批判性思维弱化的担忧。

研究:聊天机器人“迎合式”对话或加重易感人群的妄想症状

研究指出,大型语言模型驱动的聊天机器人因倾向于附和用户观点,可能在精神疾病易感人群中强化甚至塑造与人工智能相关的妄想信念。

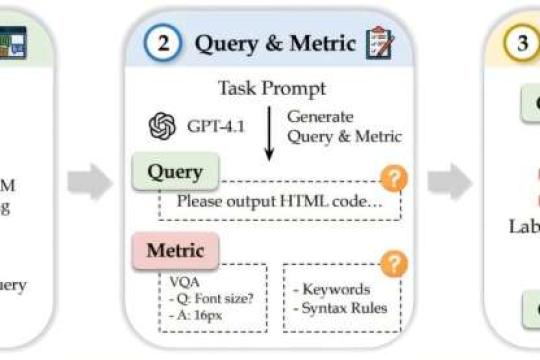

研究:顶级AI编码工具在结构化输出中约四分之一结果出错

滑铁卢大学最新研究显示,即便是最先进的大型语言模型,在结构化输出的软件开发任务中也只能达到约75%的准确率,可靠性仍不足以脱离人工监督。

数学家发起“First Proof”挑战,测试AI在研究级数学证明中的能力边界

由哈佛、斯坦福等多所高校数学家组成的团队发布10道未公开研究题,邀请AI公司作答,以更客观评估人工智能在研究数学证明环节的实际水平。

研究:ChatGPT在科学真假判断中仅获“D”等表现

华盛顿州立大学团队用数百条科学假设测试ChatGPT的真假判断能力,结果显示其准确率虽高于随机猜测,但仍远不足以被视为可靠工具,且在同一问题上的回答前后不一。

一种更有效识别过度自信大型语言模型的方法

这项新的不确定性度量方法能够识别模型幻觉,帮助用户判断是否信任AI模型。

Perplexity推出新“Computer”工具 强调多模型协同与高端订阅定位

Perplexity面向每月200美元的最高订阅档推出新工具“Perplexity Computer”,主打多模型协同与复杂工作流自动化,进一步押注高价值专业用户市场。

借鉴鸟群行为的新算法,帮助大模型减少长文档摘要“幻觉”

研究团队提出一种受鸟群自组织启发的预处理框架,将长文档拆分并聚类为“句子鸟群”,在输入大型语言模型前先去噪与去重,从而提升长文档摘要的事实准确性。

小型边缘计算机或成农村自动驾驶“本地大脑”

华盛顿州立大学研究表明,将压缩后的大型语言模型部署在廉价小型计算模块上,有望在网络不稳定的农村地区,为自动驾驶车辆提供本地决策能力。

研究:AI 代理已能自主协同发动宣传战,无需人工指挥

南加州大学团队通过大规模模拟发现,大型语言模型驱动的 AI 代理可以在几乎没有人工干预的情况下,自主协同放大同一叙事,制造“共识假象”,对选举等民主进程构成现实威胁。

人工智能加速“出圈”:从虚拟走向现实世界

自动驾驶与类人机器人等应用正在推动人工智能从虚拟空间走向实体世界,相关技术进展与潜在风险同步显现。