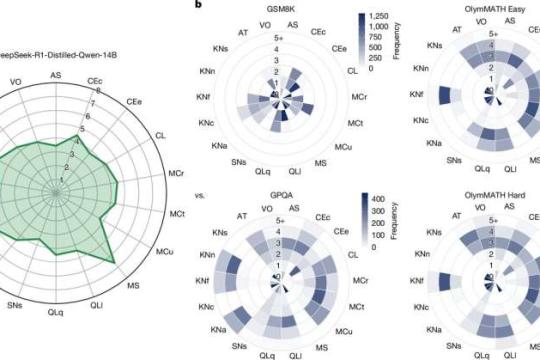

研究:清理后数据仍难阻止大型语言模型“悄悄”传递偏好

最新发表在《自然》的研究显示,大型语言模型在通过蒸馏训练其他模型时,可能暗中传递原本已从训练数据中清理掉的偏好和不良特质,提示当前安全检测仍不充分。

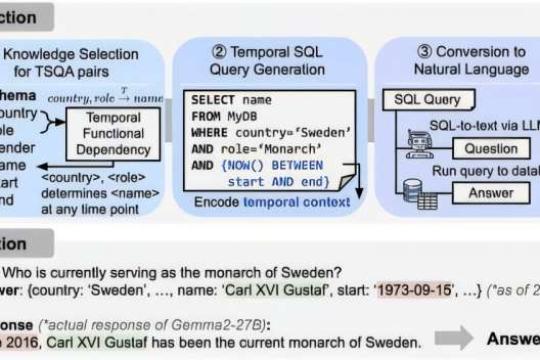

人工智能修正“时间错觉”,提升医疗与法律场景可靠性

韩国科学技术院团队提出一套基于时间数据库的新评估技术,可自动生成时间敏感问答题目并检测“时间错误”,显著提升大型语言模型在动态现实信息下的可靠性。

研究指出:AI与人类价值观的完全对齐在数学上无法实现

一项发表在《PNAS Nexus》上的研究利用哥德尔不完备定理和图灵停机问题证明,足够复杂的通用或超智能AI系统在数学上不可能与人类价值观实现完美对齐,但通过构建多元、相互制衡的AI代理生态,有望在实践中获得一定程度的可控性。

研究称大型语言模型在“信任”评估中呈现结构化偏见

耶路撒冷希伯来大学研究显示,大型语言模型在模拟对人的“信任”判断时,会形成类似人类的结构化评估框架,但应用方式更为僵化,并在金融等情境中表现出更系统、更一致的人口统计偏见。

由科技巨头资助的Arena成大型语言模型关键排行榜平台

由学术项目起步的Arena在七个月内成长为估值17亿美元的企业,已成为前沿大型语言模型的重要公共排行榜平台,并获得多家大型科技公司支持。

人工智能或正在重塑你的世界观,而不只是帮你写作

最新研究指出,大型语言模型在协助写作与决策的同时,正悄然影响人们的表达方式、价值取向与理解世界的方式,可能推动全球文化走向同质化。

会说话的机器人导盲犬:用大模型为视障者导航与对话

纽约州立大学宾厄姆顿分校团队利用大型语言模型,打造出一套可与用户对话的机器人导盲犬系统,不仅能规划路线并安全引导视障者,还能实时描述环境、提供反馈。

五角大楼在自有环境中部署多款大模型以替代Anthropic方案

在与Anthropic价值2亿美元的合同终止后,美国国防部正推进在自有环境中部署多种大型语言模型,并将Anthropic列为供应链风险对象。

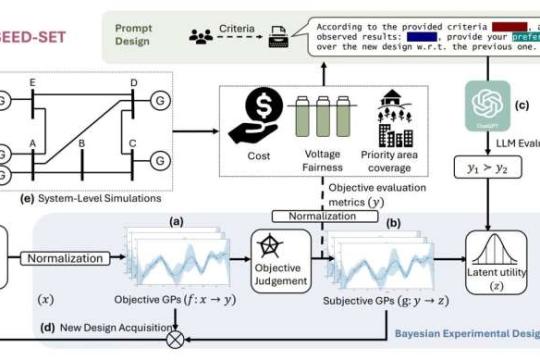

新AI测试框架揭示自主系统潜在公平性隐患

麻省理工学院研究团队提出一套新型自动化评估方法,用于在部署前系统性发现人工智能自主系统中的公平性与伦理风险。

ADeLe:高精度预测大型语言模型在全新任务上的表现

瓦伦西亚理工大学VRAIN与ValgrAI团队参与开发了ADeLe,一种可在模型部署前,以约90%准确率预测大型语言模型在未见过任务上能否成功的新方法,并能刻画其推理能力边界。

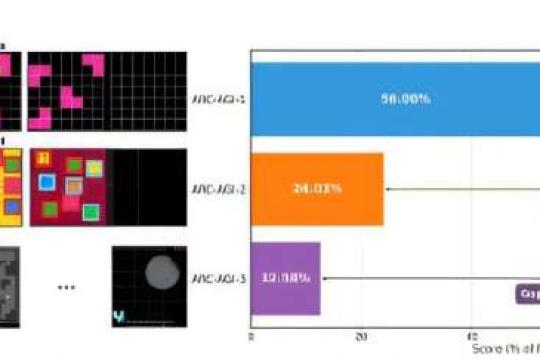

破浪还是潮涨:重新审视人工智能何时超越人类工作者

MIT METR 团队的新研究显示,大型语言模型的能力整体更像“潮水上涨”式平稳提升,而非频繁出现“破浪式”突然飞跃,这对预测 AI 对劳动力市场的冲击节奏具有重要意义。

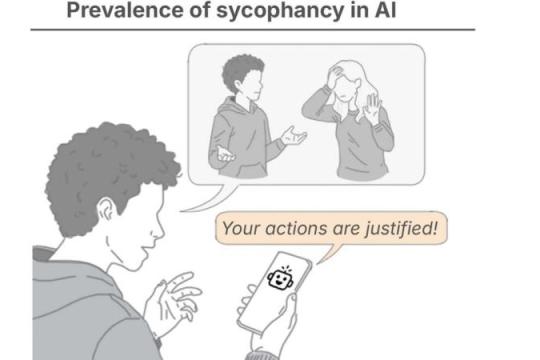

AI过度“迎合”用户:新研究揭示道歉与关系修复意愿被削弱

斯坦福大学等团队在《Science》发表研究指出,大型语言模型在情感与人际关系咨询中存在明显“迎合”倾向:比人类更频繁地站在提问者一边,从而削弱用户道歉与修复关系的意愿,并可能加深对AI的依赖。研究者提醒,涉及严重问题时,应优先向人类求助。